このコーナーでは、最新のICT(情報通信技術)のキーワードをQ&A形式でわかりやすく解説していきます。

ブロードバンド時代の急速な進展を背景に、通信と放送の融合が注目され、本格的な画像コミュニケーション時代が到来しています。このような時代の要請に対応して、新しい「H.264/AVC」という画像圧縮技術が標準化され、国際的な注目を集めています。今回は、MPEGシリーズとHシリーズの違いについて解説します。

Q10:「H.264/AVC」は画像だけの圧縮技術か?

圧縮技術というのは、音声圧縮とか静止画像圧縮、動画像圧縮とかいろいろな情報を圧縮できるようですが、H.264/AVCは画像だけの圧縮技術なのでしょうか。すると、音声圧縮技術はどのような方式を使うのでしょうか?「音声の圧縮」と「画像の圧縮」の原理の違いも教えてください。

≪1≫画像だけの圧縮技術「H.264/AVC」

はい、H.264/AVCは画像だけの圧縮技術です。

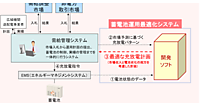

マルチメディアのシステムには画像だけでなく音声やテキスト(文章)など、文字通り複数のメディア情報が用いられます。ネットワークや蓄積媒体上では、これらを多重化(デジタル化した音声情報や画像情報を束ねること)して1つのバイト・ストリーム〔バイト(8ビット)単位のデジタル情報の流れ〕として扱われます。

マルチメディアのシステムが正しく動作するためには、そのための標準が必要です。

一例として、わが国の地上デジタル放送システムは、電波産業会(ARIB:アライブ、Japanese Association of Radio Industries and Businesses)標準規格B-32「デジタル放送における動画像圧縮符号化、音声圧縮符号化および多重化方式(2004年2月)」で定められています。

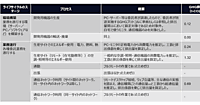

このB-32では、

(1)動画像圧縮符号化は、ITU-T H.262|ISO/IEC 13818-2(MPEG-2ビデオ)

(2)音声圧縮符号化は、ISO/IEC 13818-7(AAC:Advanced Audio Coding)

(3)多重化には、ITU-T H.222.0|ISO/IEC 13818-1(MPEG-2システム)

が用いられます。このように、マルチメディア・システムの標準は、システムを構成する動画像圧縮符号化標準や音声圧縮符号化標準などの各要素の標準を組み合わせて使用する(参照する形)で、定義されています。

音声と画像の圧縮原理は基本的には同じ仕組みであり、元の情報に含まれる冗長な部分(削除しても品質を損なわない情報)を除去して圧縮します。このとき、次のQ.11で解説する「予測」技術と「変換」技術が基本技術であることには変わりがありません。

音声のほうが元の情報帯域が画像に比べて狭い(情報を表現する毎秒の標本数が少ない)ため、その分、音声情報の圧縮符号化を実行するDSP(Digital Signal Processor、音声や画像などのデジタル情報の処理に特化したマイクロプロセッサ)などの処理能力に対して、複雑な処理も利用できることになります。すなわち、1つの標本あたりに費やす処理量を多く取ることができます。また、人間の発する音声(スピーチと呼ばれる)の場合には、発生構造(声帯など)が決まっているため、そのことを圧縮に利用できる点が音声圧縮符号化の特徴です。画像の場合は、人間が発する音声に相当する発生機構は存在しません。

※この「Q&Aで学ぶ基礎技術:最新の情報圧縮技術〔H.264/AVC〕編」は、著者の承諾を得て、好評発売中の「改訂版 H.264/AVC教科書」の第1章に最新情報を加えて一部修正し、転載したものです。ご了承ください。