PUE=1.0を実現する抜本的省エネデータセンターの構成:世界初の自然循環方式と冷媒の滴下方式の開発

〔1〕「高」「中」「低」の3つの各ゾーンに分割

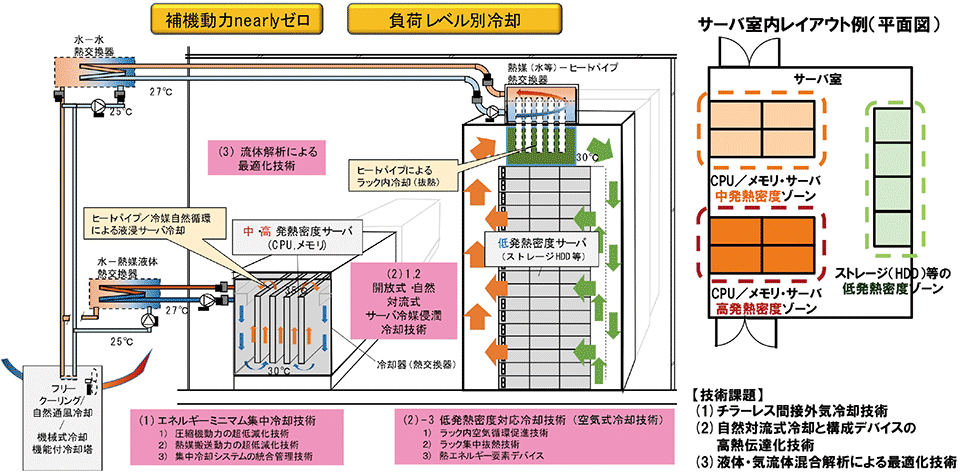

図5に、今プロジェクトの目標であるPUE=1.0を実現する、抜本的省エネデータセンターの構成を示す。

図5 PUE=1.0を実現する抜本的省エネデータセンターの構成(全体像:イメージ)

出所 環境省・平成28年度CO2排出削減対策強化誘導型技術開発・実証事業「データセンタの抜本的低炭素化」、2016年11月7日

図5の右に示すサーバ室内レイアウト例(平面図)には、前述した、

(1)「高」発熱密度ゾーン:CPU/メモリ・サーバ

(2)「中」発熱密度ゾーン:CPU/メモリ・サーバ

(3)「低」発熱密度ゾーン:ストレージ(HDD)

などが設置されている。

図5の左側は、この(1)〜(3)の3つのゾーンを分担しているそれぞれの冷却装置である。左側の図の右に示す大きな長方体部分(オレンジ色と緑色の矢印が循環している部分)が、低発熱密度サーバ(ストレージHDD)を空冷で冷却している部分である(ハードディスクの設置間隔が2〜3mmなので空気の流量の設計が重要となる)。上部に示す熱交換器で冷却し、室温を30℃に保っている。このとき、空調用のファンモーターが必要となるが、その消費電力は通常1〜2kWにも達するため、これをいかにゼロにしていくかも課題である。

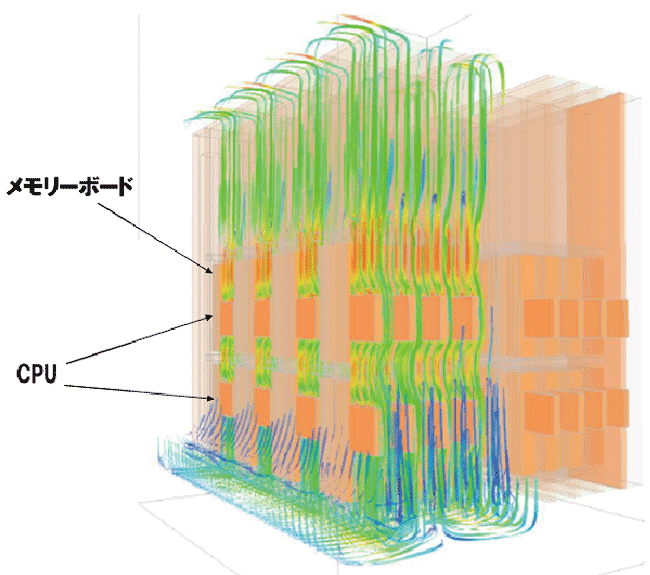

図6 世界初の冷媒の自然対流による冷却をシミュレーションした様子

※多くの線は冷媒の流れを表しており、その色は温度を示している。25℃の冷媒(青い部分)がCPUを過ぎると温度が上昇している(緑の部分)のがわかる。

出所 環境省・平成28年度CO2排出削減対策強化誘導型技術開発・実証事業「データセンタの抜本的低炭素化」、2016年11月7日

図5の左側の図の中央に示すのが、中・高発熱密度サーバ(CPU、メモリ)を冷却している部分である。冷媒(現在は、3M社のフロン系フロリナートという冷媒等を使用)で満たされた冷却器内にサーバをジャブ漬けにする液浸サーバ冷却方式である。これも熱交換器で冷却し、冷却器内を30℃に保っている。本事業では、PUE=1.0を実現するため、サーバを格納する冷却箱内で冷媒の循環のためのポンプやファンを配置していない。高発熱密度に対しては自然循環方式(図6)を、中発熱密度に対しては冷媒の滴下方式を、世界で初めて開発する。

〔2〕熱交換器のポンプの消費電力をゼロへ

本実証では、冷却箱内に冷媒を循環させるためにポンプやファンを使わない世界初の自然循環方式や液下方式を採用するが、ここで重要なのは、熱交換のために使用する水を循環させるために、ポンプを使用することである。この熱交換のためのポンプの消費電力をいかにゼロに近づけるかということも、今プロジェクトの課題である(PUE=1.0を実現するには、このポンプのモーターの消費電力をゼロにする必要がある)。

このほか、各サーバ自身に冷却用の小型ファンが取り付けられているが、このファンの消費電力をいかになくすか(あるいは省電力するか)という課題もある。近年、この小型ファンは回りっぱなしということはなく、CPUの温度が一定以上に上昇すると回転するなど、省電力化の工夫がなされてきている。

〔3〕液浸サーバ冷却方式の仕組み

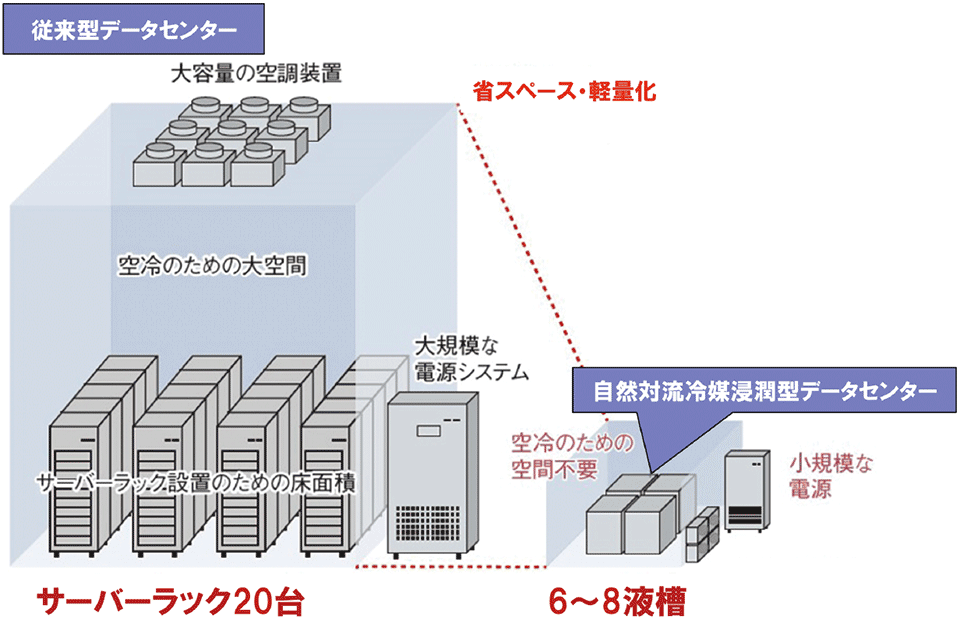

図7に、図5に示した高発熱密度に対応した液浸注12サーバ冷却方式の仕組みを示す。

図7 高発熱密度対応冷却方式(液浸)

出所 環境省・平成28年度CO2排出削減対策強化誘導型技術開発・実証事業「データセンタの抜本的低炭素化」、2016年11月7日

図7の左側は従来型のデータセンター(空冷のため大きな空間が必要であった)であるが、今回、これを超省スペース化するとともに、世界初の自然対流による冷媒浸潤型の超小型データセンターへと進化させた。

図7右下にある4つの液槽の中にサーバ基盤を格納する。1つの液槽の中には、32個(32枚)のサーバ基盤が格納できる。

中発熱密度に対しては、世界初の冷媒の滴下方式の採用によって、必要な冷媒の量を冷媒浸潤型に比べて10分の1に減少させることができ、大幅に軽量化させた。

▼ 注12

液浸:えきしん。液体浸潤のこと。