“ビット”の誕生デジタル情報の発展を導いた通信の数学理論

“ビット”の誕生

デジタル情報の発展を導いた通信の数学理論

シャノンは、ウィナーやチューリングの知識を吸収し、ベル研究所で電信において信号が変化する法則を対数で定式化したハリー・ナイキストの助言を得ながら、PCMを研究して情報伝達の核心に迫っていく。

ウィナーはノイズを含むデータから必要な信号を抜き出す方法を示していたが、シャノンは情報の源に注意を向けた。チューリングによれば、情報は有限の数の記号であり、記号は1と0の2進数で符号化できる。シャノンは情報の源が2進数の数(binary digit)で表現できるのなら、情報は単なる量になると考えた。シャノンの同僚のジョン・テューキーは、この量を測る最小単位のbinary digitを縮めてビット(bit)と名付けた。

シャノンはこうして情報から意味を切り離して、ノイズが混入する通信経路で情報を間違いなく伝達する要件を考察した。通信経路にはノイズが混入するが、伝達できる情報の量には限界がある。

符号化した情報の基本単位は1と0の1ビット(=21=2)なので、情報は2の累乗の数で表現できる。例えば、 ASCIIの文字セットには256種類の文字があるため、1文字を送信するのに必要なビット数は、

256=2n

のn(ビット)となり、nは2を底とした対数から求めることができるので、

log2 256=log2 28=8

によってn=8となる。この事からこの情報(ASCIIコードでの1文字)は8ビットで送信できる事が確認できる。シャノンはこうして、log2 M=nの関係を導いた。

このように、2のn乗のnは、ひとつの記号を表現するビット数で、1秒間に伝送できるビット数(帯域幅)には限界がある。シャノンは1943年末に、帯域幅を最大限活用して情報を符号化すれば、ノイズが混入する可能性が限りなく小さくなると予想した。

シャノンが導いた公式は、ボルツマンによるエントロピーの確率論的公式S=κ log ωと極めて近い関係を示していた。熱力学の第2法則では、エントロピーの増加に逆行する現象が起きる確率は無視できるほど小さい。

シャノンは戦後、同僚の薦めで1943年末にたどり着いた考察を、「通信の数学理論」(A Mathematical Theory of Communication)にまとめ上げ、1948年のベル・システム・テクニカル・ジャーナルの7月号と10月号で発表した。

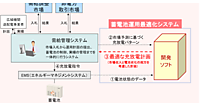

サンプリング理論の発展

シャノンが一般化した通信システムは、情報源と通信経路の間にエンコーダを配置し、通信経路の出口にデコーダを配置している。エンコーダは、情報源をデジタル・データに符号化し、デコーダは受け取ったデジタル・データから音声や文章を復元する。符号化する情報量と所要時間は、通信経路の帯域幅の範囲内で最適化せざるえない。

シャノンは1949年に「ノイズが介在する通信」(Communication in the presense of noise)で、ナイキストが1928年に提示したサンプリング定理の有効性を証明した。ビット数で計測できる情報を統計的に分析すると、音声の波形は一定のビット数でサンプリングして、帯域幅の範囲に収めて伝達したり記録することができる。

人間の網膜がとらえる映像は、網膜のセルが対象物を「明るい」と「暗い」で識別しているので、やはり1か0で表現ができる。「明るい」と「暗い」の間の階調の数を増やしていくと、細かい濃淡を表現することができ、表現できる色も増える。サンプリング理論は、音声でも映像でも、帯域幅の範囲内でビット数により解像度を決めることができ、ノイズがほとんどない情報を伝達できることを示した。

シャノンは次いで、ベル研究所のリチャード・ハミングと、エラー訂正コードにより信頼性が高まることを示し、さらに1949年の論文「機密システムの通信理論」で暗号鍵によるスクランブルをノイズと関係づけて分析し、米国における暗号研究に先鞭をつけた。