GPU向けクラウド基盤ソフトウェア「Infrinia」の特長

GPU向けクラウド基盤ソフトウェア「Infrinia」の特長

Infriniaを導入すると何が実現できるのだろうか。ここでは、その主な特徴を見ていく。

〔1〕マルチテナントGPUクラウドの実現

GPUリソースを柔軟に利用できるサービスを提供する際には、複数のユーザー(テナント)間で、図3のように、それぞれ隔離された環境を構築することが重要となる。その作業手順は次のようになる(図4)。

(1)ユーザーの要望に応じた、データセンターの空きリソースからCPU、GPU、ストレージのリソースを抽出

(2)抽出されたリソースを、独立したネットワークとして隔離

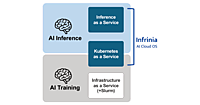

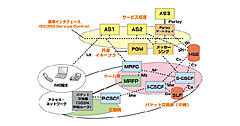

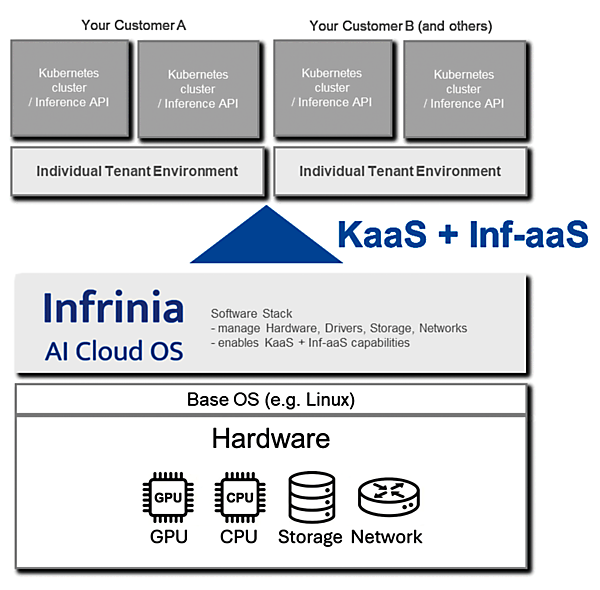

図3 InfriniaのインストールでマルチテナントのGPUクラウド環境の構築・運用が簡便かつ迅速に実現

図下段に示すデータセンターのリソースに、ソフトウェア「Infrinia」をインストール(図中段)することで、KaaSおよびInf-aaSの提供が可能となる。これによって、テナント(ユーザー)ごとに完全に隔離された環境下(図上部)で、Kubernetesワークロードや推論サービスを安定して稼働させることができる。

図は、Infriniaが、複雑な物理リソースと高度なサービス(KaaS/Inf-aaS)を仲介する抽象化レイヤとして機能することを示している。

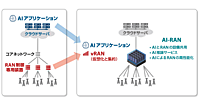

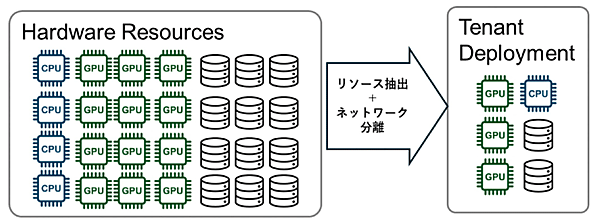

図4 Infriniaはユーザーが求めるGPUリソースを抽出・隔離し柔軟なサービス提供が可能

図左側に示すGPUクラウド事業者のデータセンターリソースから、ユーザーが求める最適なリソースを抽出。それらをネットワークで分離することで、ユーザーごとに隔離された専用環境を構築している(図右)。

この作業は、ユーザーのリソース要求が毎回異なるうえに、GPU間のネットワーク(NVLink注5)の隔離作業も必要になるため、1回のシステム開発ごとに、高スキル技術者の確保と開発日数が必要となってしまう。これではオンデマンドのサービスとして提供することは難しい。

Infriniaをインストールすると、GPUクラウドサービスの構築や運用に数日間かかることもなく、かつ自動で実現できる。ユーザーがコーヒーを入れて飲み終わる頃には、要求した環境が作られていることだろう。

〔2〕Kubernetesによる高い互換性

AI学習やGPU処理の領域では、Kubernetesの利用が主流となっている。InfriniaはKubernetes環境を提供するため、同環境でAI開発を行っている事業者と優れた親和性をもつ。従来のクラウドサービスと同様に、柔軟で容易なプラットフォームへの移行を可能とする。このことは、GPUクラウドを新たに展開する事業者にとっても、またそのユーザーにとっても大きなメリットとなる。

ちなみに、GPUクラウド事業者の中にはKubernetes自体に独自の拡張をしているケースもあるが、Infriniaが提供するのは一般的なKubernetesにきわめて近く、ユーザーは新たに使用方法を学ぶ必要はない。

また、InfriniaはNVIDIAのリファレンスアーキテクチャに準拠するとともに、データセンター全体を包括する注6設計思想をもつ。これによって、同様の構成をもつ各社のデータセンターに対してソフトウェアとして提供することも可能となった。その結果、このシステムは自社利用の枠を超え、他環境への適用などGPUクラウドの運用モデルそのものを柔軟に拡張する可能性をももつ。

注5:NVLink :NVIDIAが開発した、GPU同士を接続し高速にデータを送受信する独自技術。

注6:データセンター内のファシリティ、ITインフラ、運用のすべてを個別管理するのではなく、一元的に「管理」「最適化」「把握」すること。